手机端AI助手访问量同比暴增107%,桌面端达到8300万独立访客,ChatGPT月活突破9.56亿——这些数字背后,AI助手正从“玩具”走向“日常工具”-1。但AI助手到底好不好?它靠什么工作?开发者和学习者又该如何正确看待和使用它?

一、为什么我们需要AI助手——痛点切入

假设你想写一个“判断字符串是否为回文”的函数。传统方式是这样的:

传统开发流程def is_palindrome(s: str) -> bool: 手动编写逻辑 return s == s[::-1] 需要手动编写、调试、测试、优化 耗时约3-5分钟

这个流程的痛点显而易见:重复劳动多、查找资料耗时、错误率不稳定。更严重的是,当你面对的是几千行代码的重构、不熟悉的框架集成、或者复杂的算法设计时,传统方式会暴露出致命缺陷——效率天花板低、知识覆盖面有限、试错成本高。

AI助手正是为打破这些瓶颈而生。它通过大语言模型(LLM)的海量知识储备和代码生成能力,将“从零到一”的编码时间大幅压缩。据2026年实测数据,使用AI代码助手的开发者每日编码时间平均减少1.5小时,代码采纳率提升33%-。

二、核心概念:AI助手

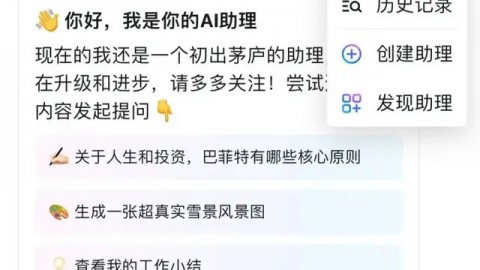

定义:AI助手(Artificial Intelligence Assistant)是基于大语言模型构建的智能对话系统,能够理解自然语言指令,完成文本生成、代码编写、知识问答、任务规划等多种任务。

生活化类比:如果把传统引擎比作“图书馆管理员”——需要你自己翻阅、筛选、提炼;那么AI助手就像“私人研究员”——你提出目标,它帮你查资料、做分析、给方案,甚至直接生成成果。

核心作用:

提高效率:自动化处理重复性工作

降低门槛:让非专家也能完成专业任务

拓展能力:辅助思考、激发创意、加速学习

三、关联概念:AI Agent

定义:AI Agent(AI智能体)是AI助手的进阶形态——不仅具备对话能力,还拥有自主规划、工具调用、记忆管理、多步执行的能力-24。

对比关系:

| 维度 | AI助手 | AI Agent |

|---|---|---|

| 交互模式 | 用户提问 → 模型回答 | 用户提出目标 → Agent规划执行 |

| 任务跨度 | 单次对话 | 持续多步执行 |

| 工具使用 | 有限或不具备 | 主动调用API、、代码执行 |

| 记忆能力 | 有限上下文 | 长期记忆+工作记忆 |

一句话理解:AI助手是“问答机器人”,AI Agent是“任务执行者”。

四、主流模型对比:谁更好?

2026年的AI助手市场已呈现多足鼎立格局。根据Comscore 2026年1月发布的数据,12月移动端AI助手总访问量达5430万(同比+107%),桌面端达8300万(同比+18%),ChatGPT以移动端3450万、桌面端5640万的规模领先-1。

以下从开发者最关心的四个维度对比主流模型:

4.1 编程能力

DeepSeek:在数学密集、逻辑驱动的编程任务中表现出色,输出精确结构化-。采用MoE(混合专家)架构,671B总参数但每次仅激活37B,推理成本约为GPT-4的1/4.5-11。

GPT-4.1:代码生成和指令遵循增强版,1M上下文窗口,API定价$2/8 per MTok(输出),生态成熟度最高-14。

Claude Opus 4.6:SWE-bench 72.7%,当前Agent编程和Computer Use场景的最优模型,输出$25/MTok-14。

4.2 成本与性价比

极致性价比:DeepSeek-V3.2($0.28/$1.12 per MTok)、Gemini 2.5 Flash-Lite($0.10/$0.40),适合大规模批量处理-14。

均衡旗舰:Claude Sonnet 4.6($3/$15)、GPT-4.1($2/$8),综合能力最强-14。

4.3 准确率与幻觉

2025年底谷歌发布的FACTS基准测试显示,所有顶尖模型综合准确率均未超过70%——Gemini 3 Pro以68.8%领跑,GPT-5为61.8%,Claude 4.5 Opus为51.3%-39。在医疗咨询场景中,豆包大模型幻觉率为8.2%,文心一言为11.5%,DeepSeek-R1为9.7%-41。

结论:AI助手远非“完美”,“信任但要核实”的原则依然适用。

五、代码示例:调用AI助手API

以下是用DeepSeek API(兼容OpenAI SDK)实现一个简单代码助手的示例:

from openai import OpenAI 初始化客户端(DeepSeek兼容OpenAI SDK) client = OpenAI( api_key="YOUR_DEEPSEEK_API_KEY", base_url="https://api.deepseek.com" ) 调用AI助手生成代码 response = client.chat.completions.create( model="deepseek-chat", DeepSeek-V3模型 messages=[ {"role": "system", "content": "你是一个专业的Python编程助手。"}, {"role": "user", "content": "写一个函数,用快速排序算法对列表进行排序,并添加注释"} ], temperature=0.7, max_tokens=1024 ) print(response.choices[0].message.content)

执行流程:

客户端将用户问题封装为API请求发送至模型服务器

模型进行推理计算,生成符合要求的代码

返回结构化响应,包含生成的代码和解释

关键点:temperature参数控制创造性(0=最保守,1=最发散),适合代码生成的场景建议设在0.3-0.7之间。

六、底层原理:AI助手是怎么工作的?

AI助手的底层技术栈可以理解为三层架构-28:

第一层:大模型层(底座) —— 提供智能的“发动机”。模型通过海量数据预训练获得语言理解、推理和生成能力。DeepSeek采用的MoE架构允许在671B参数中仅激活37B,大幅降低计算成本-11。

第二层:AI框架层(传动系统) —— 包括LangChain、LangGraph等框架,负责将模型的自然语言能力转化为可控、可复用的工程结构-28:

LangChain:将模型输出转化为可编排的执行逻辑

LangGraph:支持多步任务的图状态管理

MCP(Model Context Protocol):模型与外部环境的数据通信协议

第三层:工具与生态层(车轮) —— 让AI助手真正“动手”:调用数据库、引擎、代码执行器等外部能力。

如果想深入源码层面的实现原理,后续会有专门文章详解Transformer架构和注意力机制。

七、工程化挑战:为什么落地没那么简单?

根据阿里云2026年4月发布的工程化分析报告,AI Agent从Demo走向企业级落地面临六大挑战-49:

任务路径坍塌:多步推理中微小偏差累积导致任务失败 → 对策:使用LangGraph状态机强制约束行为边界

RAG深度不足:简单的向量检索无法满足复杂业务需求 → 对策:转向GraphRAG或Agentic RAG

成本失控:Agent反复调用高阶模型 → 对策:模型路由策略,简单任务用轻量模型

工具调用风险:权限黑盒化,越权操作风险 → 对策:最小权限原则 + 人类在环(Human-in-the-loop)确认

合规硬约束:生成内容触碰法律红线 → 对策:前置安全护栏(Guardrails)

记忆容量危机:上下文窗口被填满 → 对策:分层记忆架构(永久记忆+工作记忆+向量冷存储)-49

Gartner预测,到2027年超过40%的Agentic AI项目将被废弃,原因不是模型不行,而是企业无法将其运营化-51。

八、高频面试题与参考答案

面试题1:AI助手和传统引擎有什么区别?

参考答案:引擎通过关键词匹配返回相关网页链接,需要用户自行筛选和提炼;AI助手通过大语言模型理解自然语言意图,直接生成结构化答案。引擎适合“找到信息”,AI助手适合“获得答案”。

面试题2:请解释AI Agent的核心组件及其作用。

参考答案:AI Agent核心组件包括:①LLM大脑——决策和推理的来源;②规划模块(Planning) ——将复杂任务拆解为可执行步骤;③记忆系统(Memory) ——包括短期对话记忆和长期语义记忆;④工具使用(Tool Use) ——调用外部API执行具体操作;⑤多智能体协作——多个Agent分工完成复杂任务-24。

面试题3:如何评估一个AI助手的可靠性?

参考答案:主要从三个维度评估:①准确性/幻觉率——生成内容与事实一致的程度;②上下文遵循能力——是否严格遵守给定源文本;③工具调用可靠性——多步操作中错误率的累积情况。谷歌FACTS基准测试是当前企业级采购的重要参考标准-39。

面试题4:为什么AI Agent在实际落地中比预想中困难?

参考答案:主要瓶颈在于工程化,而非模型能力本身。具体包括:多步推理中的路径坍塌、RAG检索的信息破碎、成本失控、权限安全隐患、合规要求、以及长上下文记忆管理。2026年的决胜关键在于“工程确定性”——宁可让Agent停下来询问,也不要在错误路径上跑太远-49。

九、结尾总结

回顾全文核心知识点:

| 要点 | 关键信息 |

|---|---|

| AI助手的本质 | 基于LLM的对话系统,提升效率、降低门槛 |

| AI vs Agent | 助手是“问答机器人”,Agent是“任务执行者” |

| 主流模型 | DeepSeek(性价比)、GPT-4.1(生态)、Claude(编程能力) |

| 底层原理 | LLM+框架层+工具层三层架构 |

| 工程挑战 | 路径坍塌、RAG深度不足、成本失控等六大问题 |

| 评估标准 | FACTS基准测试、幻觉率、上下文遵循 |

重点记住:AI助手不是“完美智能”,而是“强大工具”。学会用它,但不盲目信它——“信任但要核实”是AI时代的核心准则。

📌 下一篇预告:我们将深入AI Agent的核心实现——LangGraph状态机设计与多智能体协同实战,敬请关注。