2026年被称为“智能体爆发年”,AI Agent正从实验室概念走向规模化落地-14。本文带你系统掌握 Agent 的核心架构、工作机制与主流框架选型。

一、开篇:为什么2026年必须理解AI Agent

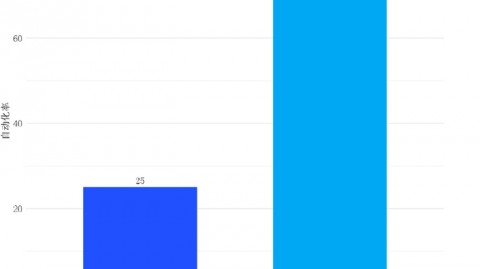

AI Agent(人工智能智能体)正处于从“概念验证”迈向“规模化落地”的关键拐点。Gartner预测,到2026年底,40%的企业应用将包含特定任务的AI Agent-;IDC预计活跃Agent的数量将从2025年的2860万飙升至2030年的22.16亿-。2026年也被业界普遍视为“智能体爆发年”-14。

这一技术跃迁的背后,是四个基本条件的同时成熟:基础模型能力突破推理门槛、工具生态基础设施成熟、企业AI治理体系逐步建立,以及推理成本两年内下降超过95%-14。

许多学习者在面对 AI Agent 时,普遍存在几个痛点:只会调用 API 调用却不懂底层原理、将“智能体”与“大模型”混为一谈、面试时被问到 ReAct、工具调用等核心概念答不出。本文将从“问题→概念→示例→原理→考点”的完整链路,带你系统掌握 AI Agent 的核心知识体系。

二、痛点切入:为什么需要 AI Agent?

传统 AI 应用的交互模式是“一问一答”式的。当你问一个 LLM“帮我查询今天北京的天气,并根据天气预订一家评分最高的中餐厅”时,它只能给出文字建议,无法真正执行查询天气、调用预订 API 等“动作”。

让我们来看一个典型的“传统方式”:

❌ 传统方式:LLM 只能输出文本,无法执行动作 def traditional_llm_response(user_query): 模型只能返回建议性的文本 return "建议您打开天气App查看北京天气,然后通过美团App预订餐厅。"

这种方式的缺点显而易见:仅能提供建议而非行动、无法与外部系统交互、无法完成多步骤复杂任务、用户需要自行执行所有后续操作。

而 AI Agent 的出现,正是为了打破这层壁垒。它将 LLM 从一个“语言模型”升级为能够与数字世界甚至物理世界交互的“行动者”-62。

✅ Agent 方式:能够自主规划并调用工具执行 def agent_execute(user_query): Step 1: 规划子任务 subtasks = ["查询北京天气", "根据天气筛选餐厅", "调用预订API"] Step 2: 调用工具执行 weather = call_api("weather", {"city": "北京"}) restaurants = call_api("search_restaurant", {"weather": weather}) booking = call_api("book_restaurant", restaurants[0]) return booking 直接交付结果

三、核心概念讲解:AI Agent 的定义与拆解

AI Agent(Artificial Intelligence Agent,人工智能智能体) 是一种能够感知环境、自主决策并执行任务以实现特定目标的智能系统-2。简单来说,Agent 就是一个以 LLM 为“大脑”的自主系统,能够理解复杂目标、进行规划,并调用外部工具来执行任务-62。

生活中的类比:Agent 像一个“数字管家”

想象一下,你告诉管家:“帮我准备今晚的生日聚会”。这位管家会:理解任务(聚会策划)、拆解步骤(采购→布置→邀请→准备餐饮)、调用资源(打电话给花店、预订蛋糕、发邀请函),最后向你汇报结果。AI Agent 就是数字世界里的这位“管家”——它不是只会回答问题,而是能够自主完成任务。

从架构层面看,Agent 的核心能力可归纳为四大模块-34:

| 能力模块 | 功能说明 | 技术实现 |

|---|---|---|

| 感知与规划 | 读懂复杂世界,分解目标为子任务 | 多模态感知、任务分解算法 |

| 记忆 | 跨时间的上下文管理 | 工作记忆、情节记忆、语义记忆、程序记忆 |

| 行动 | 真实接入系统,执行操作 | API 调用、代码执行、UI 操控 |

| 信任 | 可解释、可审计、可干预 | 行为日志、决策追踪、权限管控 |

⚠️ 易混淆点:Agent ≠ LLM!LLM 只是 Agent 的“大脑”,Agent 还包含规划、记忆、工具调用等完整系统。

四、关联概念讲解:ReAct 框架

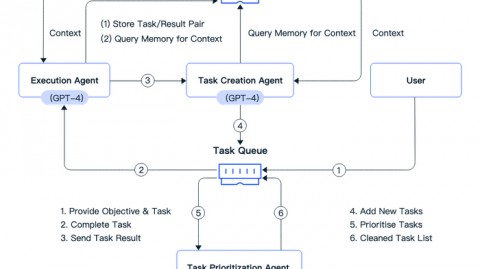

ReAct(Reasoning + Acting,推理与行动交替框架) 是驱动现代 Agent 工作的核心模式。它通过交替生成“思考”与“行动”来完成复杂任务-62-70。

ReAct 与 Agent 的关系

一句话总结:Agent 是“系统架构”,ReAct 是“工作机制”。 Agent 定义了系统包含哪些组件(大脑、规划、记忆、工具等),而 ReAct 描述了这些组件如何协同工作的具体模式。

ReAct 的“思考-行动”循环

在一个典型的 ReAct 循环中,LLM 会交替进行三个步骤-62:

ReAct 伪代码示例 def react_loop(user_query): thought = llm.think("分析当前任务,确定下一步做什么") action = llm.decide_action(thought) 决定调用哪个工具 observation = execute_tool(action) 执行工具,获得反馈 根据 observation 决定是否继续循环或输出最终答案 if task_completed: return format_answer(observation) else: return react_loop(observation) 继续下一轮

实例演示:用户问“帮我预订明天北京到上海的机票”

🤔 Thought(思考): 用户想预订明天北京到上海的机票,我需要先查询航班信息。 ⚡ Action(行动): call_tool("search_flight", from="北京", to="上海", date="明天") 👁️ Observation(观察): 查询到 3 个航班,价格分别为 680/950/1280 元 🤔 Thought(思考): 有多个选择,需要询问用户偏好后再进行预订...

ReAct 的优势

可观测性:每一步“思考”和“行动”都可追踪,便于调试

减少幻觉:通过工具调用的实际反馈验证推理,降低错误率-70

灵活性:可根据中间结果动态调整后续计划

五、概念关系与区别总结

| 对比维度 | AI Agent(系统) | LLM(组件) | ReAct(机制) |

|---|---|---|---|

| 本质 | 完整的智能系统 | 语言模型 | 工作流程模式 |

| 组成 | LLM + 规划 + 记忆 + 工具 + 执行 | 神经网络权重 | Thought-Action-Observation 循环 |

| 输入输出 | 目标 → 任务结果 | 文本 → 文本 | 任务状态 → 下一动作 |

| 自主性 | 高,可独立完成多步任务 | 低,被动响应 | 中等,驱动自主行为 |

📌 记忆口诀:Agent 是“总指挥”,LLM 是“大脑”,ReAct 是“工作流程”。

六、代码实战:构建一个简易的天气查询 Agent

下面我们实现一个能够自主调用外部 API 的 Agent,直观展示其工作机制。

-- coding: utf-8 -- import requests import json from typing import Dict, Any class SimpleAgent: """一个简易的 AI Agent,具备工具调用能力""" def __init__(self, llm_model=None): 注册 Agent 可用的工具(工具箱) self.tools = { "get_weather": self._get_weather, "get_time": self._get_current_time, } def _get_weather(self, city: str) -> Dict[str, Any]: """调用天气 API 获取实时天气""" 模拟 API 调用(实际生产环境替换为真实 API) weather_data = requests.get(f"https://api.weather.com/{city}").json() weather_data = {"city": city, "temperature": "22°C", "condition": "晴天"} return weather_data def _get_current_time(self) -> str: """获取当前时间""" from datetime import datetime return datetime.now().strftime("%Y-%m-%d %H:%M:%S") def think_and_act(self, user_query: str) -> str: """ Agent 的核心:思考 + 行动循环 实际生产中这里会调用 LLM 进行推理和决策 """ 1. Thought: LLM 分析用户意图 if "天气" in user_query: 2. Action: 决定调用哪个工具 city = "北京" 实际应由 LLM 提取参数 result = self.tools["get_weather"](city) return f"【Agent 执行结果】{result['city']}天气:{result['temperature']},{result['condition']}" elif "时间" in user_query: result = self.tools["get_time"]() return f"【Agent 执行结果】当前时间:{result}" else: return "【Agent】无法理解您的请求,请尝试询问天气或时间。" 使用示例 agent = SimpleAgent() print(agent.think_and_act("今天北京天气怎么样?")) 输出: 【Agent 执行结果】北京天气:22°C,晴天

📌 关键点:

工具注册:Agent 需要知道有哪些工具可用(

self.tools字典)决策逻辑:LLM 根据用户输入决定调用哪个工具(本例简化,实际使用 LLM 推理)

执行反馈:工具执行结果作为 Observation 返回,支持下一轮思考

七、主流 Agent 框架横向对比

目前主流的 AI Agent 框架各有侧重,选择合适的框架是项目成功的关键。

| 框架 | 核心理念 | 适用场景 | 特点 |

|---|---|---|---|

| LangGraph | 基于图的编排 | 有状态、多步骤复杂流程 | 学习曲线陡峭,但调试工具完善,适合金融/医疗等需审计追踪的场景-43 |

| AutoGen(微软) | 对话式多 Agent 协作 | 自动化流程设计、代码生成 | 支持人机协同,配置相对复杂-43 |

| CrewAI | 多角色分工 | 快速原型验证 | 低代码,通过角色提示词即可生成 Agent(如 Researcher→Writer→Reviewer),10分钟搭建演示-43 |

框架对比口诀:复杂状态机用 LangGraph,多 Agent 对话用 AutoGen,快速原型用 CrewAI。

真实案例:Manus 的 Agent 应用

2025-2026 年,通用型 AI Agent 产品 Manus 成为现象级案例。它能够“独立思考、规划并执行复杂任务,直接交付完整成果”-55。2025 年 8 月,Manus 推出 Wide Research 功能,用户一键即可开启 100 个 Agent 并行协作,完成复杂调研任务-51。

Manus 的技术理念是“更少的结构,更多的智能”(less structure more intelligence),认为当模型足够强大、架构足够灵活时,computer use、deep research 等能力会自然涌现,无需被设计为特定的产品功能-55。

八、底层原理与技术支撑

AI Agent 的核心能力依赖于以下几个关键技术:

1. 工具调用 / 函数调用(Tool Use / Function Calling)

Agent 通过工具调用机制与外部世界交互。LLM 生成结构化的函数调用请求,系统执行后返回结果供模型继续推理-。这相当于给 LLM 装上了“手和脚”-62。

2. 记忆系统

Agent 需要管理四类记忆-34:

工作记忆:当前任务的上下文

情节记忆:历史交互记录

语义记忆:领域知识库

程序记忆:操作技能

2025 年以来,一种新兴的优化范式——上下文优化(Context Optimization)正在兴起,通过构建动态记忆系统来持续提升 Agent 能力-。

3. 规划与推理

Agent 的“大脑”依赖 LLM 的复杂推理能力。新一代模型(如 OpenAI o1、DeepSeek-R1)在复杂推理、长上下文处理上的突破,使 Agent 的长期规划能力得到质的提升-14。多智能体协作中,Agent 指挥官(Agent Commander)作为核心枢纽,负责目标解析、任务分解和动态调度-21。

4. MCP 与 A2A 协议

MCP(Model Context Protocol,模型上下文协议)和 A2A(Agent-to-Agent,智能体间通信协议)的标准化,使 AI Agent 能够真正“接入”现实世界的系统,而不只是在沙盒中运行-14。

九、高频面试题与参考答案

Q1:什么是 AI Agent?它与普通 LLM 应用的核心区别是什么?

参考答案要点:AI Agent 是以 LLM 为“大脑”的自主系统,能够理解目标、规划步骤、调用工具并执行任务。核心区别在于 自主性:普通 LLM 应用是被动响应单次提问,而 Agent 能主动规划多步骤流程、维护状态、并根据反馈动态调整-73。

踩分点:提到“自主性”“多步推理”“工具调用”“状态管理”四个关键词。

Q2:解释 ReAct 框架的工作原理及其优势。

参考答案要点:ReAct = Reasoning + Acting,通过交替执行“思考→行动→观察”的循环来处理任务。每一步先由 LLM 进行推理分析,决定调用哪个工具,执行后观察结果,再进入下一轮思考-62。优势是:①可观测性高,便于调试;②通过工具反馈验证推理,减少幻觉-70。

踩分点:描述完整循环“Thought→Action→Observation”,说明“可观测”和“减少幻觉”两个优势。

Q3:Agent 如何解决 LLM 无法获取实时数据的问题?

参考答案要点:通过 工具调用(Tool Use / Function Calling) 机制。Agent 的 LLM 部分负责意图识别和参数提取,生成结构化的函数调用请求(如 get_weather(city="北京")),由 Agent 框架执行实际 API 调用,将结果返回给 LLM 进行下一步推理--70。

踩分点:说明“工具调用”机制,区分“LLM 生成请求”和“框架执行”两个环节。

Q4:当前 AI Agent 发展的主要技术瓶颈有哪些?

参考答案要点:三大瓶颈:①长期规划可靠性:任务链超过几十步时错误率显著上升,“幻觉传导”问题未解决;②记忆架构工程化:如何在有限上下文窗口外构建高效、可检索的长期记忆体系;③跨 Agent 信任与协调:多 Agent 系统的安全通信和信任验证尚无成熟标准-34。

踩分点:三点都要覆盖,体现对前沿问题的了解。

十、结尾总结

本文系统梳理了 AI Agent 的核心知识体系,从定义到架构、从 ReAct 机制到主流框架、从代码示例到面试考点,完整覆盖了学习 AI Agent 的关键知识点。

📌 核心要点回顾:

AI Agent ≠ LLM:Agent 是完整系统,LLM 只是其中“大脑”

ReAct = 思考 + 行动 + 观察:理解这个循环是理解 Agent 工作机制的关键

四大核心能力:感知规划、记忆、行动、信任

主流框架各有侧重:LangGraph(复杂状态机)、AutoGen(多 Agent 对话)、CrewAI(快速原型)

三大技术瓶颈:长期规划可靠性、记忆工程化、跨 Agent 信任

⚠️ 易错提醒:面试和实际开发中,切忌将“能调用 API 的 LLM”直接等同于 Agent——真正的 Agent 还需要具备任务规划、状态管理、自主决策和反馈调整等完整能力-73。

🔮 展望:企业级 Agent 的成熟应用将集中在 2026 年至 2028 年,真正的“Agent 原生应用生态”可能还需要 3 至 5 年-14。接下来我们将深入探讨 Agent 记忆系统的工程化实现与 多智能体协作的信任机制,敬请期待!

参考数据来源:月狐数据《2025年全球AI Agent行业洞察报告》、IDC中国、Gartner、中信建投研报、新华网《环球》杂志等