一、开篇引入

“AI助手到底靠什么赚钱?”这是许多技术学习者在接触大模型时最先冒出的疑问。从普通用户的视角来看,ChatGPT似乎“免费”得有些离谱——每天处理数亿次对话,背后却是天文数字的算力支出。这种“免费使用”的表象之下,AI助手的盈利逻辑究竟如何运转?AI助手盈利的核心机制建立在多重商业模式之上:API调用按Token计费、分层订阅制设计、广告支持模式、企业级定制服务以及按效果付费的RaaS(Results as a Service)模式。这些模式相互交织,共同构成了当今AI助手产业的商业闭环。

本文将站在技术开发者与学习者的视角,从市场背景切入,系统拆解AI助手的主流盈利模式,分析其底层技术逻辑,对比各模式的技术实现差异,并提供代码示例与面试要点,帮助读者建立从“模式”到“原理”的完整知识链路。

二、痛点切入:为什么需要理解AI助手盈利模式

传统的软件盈利方式——一次性买断或固定月费——在AI时代面临巨大挑战。以大模型API调用为例,一套简单的订阅逻辑背后,是高度复杂的成本核算机制。

假设你开发了一个AI助手应用,集成了某大模型的API。传统做法是向用户收取固定月费。但问题随之而来:一位重度用户每天发起数百次高复杂度查询,消耗数十万Token,而另一位轻度用户每周只问几个简单问题——两者支付同样的月费,前者让开发者亏损,后者则为开发者贡献利润。这种 “订阅制下的成本倒挂” 问题,正是Anthropic在2026年3月被迫调整Claude订阅政策、禁止第三方Agent框架调用的根本原因-46。

理解AI助手盈利模式,本质上是理解算力成本如何转化为可计费的商业单元。如果你只会调用API却不懂其计费逻辑、不理解为什么有的模型贵有的便宜、不知道订阅制和按量付费分别适合什么场景,那么在技术选型和成本优化上必然吃亏——面试官也正想考察这一点。

三、核心概念讲解:盈利模式(Revenue Model)

盈利模式(Revenue Model,简称RM) ,指企业通过何种方式从产品或服务中获取收入的结构化设计。对于AI助手而言,盈利模式回答的核心问题是:谁为算力成本买单?如何定价?

拆解这一概念,有两个关键词值得深挖:

其一,“成本转嫁” 。AI助手的每一次响应背后都有明确的算力成本——Token消耗、GPU计算、电力、带宽。盈利模式的本质,就是将这部分成本转嫁给用户或广告主,同时产生盈余。

其二,“定价颗粒度” 。早期的SaaS产品按“席位”收费(如每人每月20美元)。AI助手时代,定价颗粒度正在从“订阅/席位制”向“实际消耗量”迁移,以更好适配Agent场景下用量波动较大的特征-44。Token成为新的计价单位。

生活化类比:可以把AI助手比作“按里程计费的出租车”。传统软件像“租车”——付了日费随便开,但AI的成本是动态的(堵车多烧油),所以订阅制常常算不过来账。因此有了按量付费(像打表)、广告支持(像公交补贴)、企业定制(像包车服务)等多种模式。

四、关联概念讲解:API调用、订阅制、广告模式与企业服务

AI助手的盈利并非靠单一模式实现,而是四种主要模式的组合。

1. API调用模式(按Token计费)

API(Application Programming Interface,应用程序编程接口)调用模式是最直接的盈利方式。开发者通过API接口调用大模型能力,按实际消耗的Token数量付费。

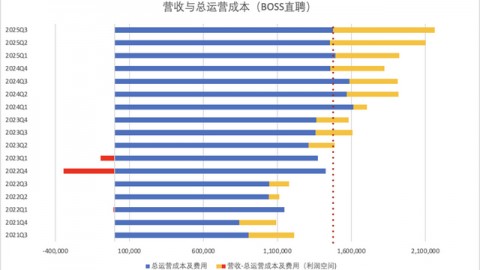

2026年3月,各主流模型的API定价(每百万Token)呈现显著分层-66:

极致性价比:豆包2.0(输入$0.11/输出$0.28)、DeepSeek-V3(输入$0.28/输出$1.10)

均衡旗舰:GPT-5($5/$15)、Claude Sonnet 4.6($3/$15)

顶级旗舰:Claude Opus 4.6($15/$75)

2. 订阅制模式(Subscription)

订阅制通过固定周期费用向用户提供AI服务。OpenAI的付费订阅用户约1500万(截至2025年中),企业付费用户超过900万(截至2026年2月)-6。订阅制的优势是收入可预测,但面临“重度用户亏钱、轻度用户赚钱”的成本倒挂风险。

3. 广告支持模式(Ad-Supported)

2026年1月,ChatGPT正式启动广告测试,标志着生成式AI商业化进入第二阶段-28。免费用户和月费8美元的Go版用户会看到广告,Pro及以上用户保持无广告体验-6。

4. 企业服务与按效果付费(RaaS)

企业级服务是当前AI助手最稳定的收入来源。客服AI Agent享有最高的估值溢价-54。更前沿的是RaaS(Results as a Service,效果即服务)模式,按实际业务成果收费,如AI客服自主解决问题才收费,转人工则免费-2。IDC预计到2028年,70%的软件供应商将重构商业模式,转向按业务结果计费-2。

五、概念关系与区别总结

四种模式并非互斥,而是根据不同用户群体和场景组合使用。一句话概括:API调用是“批发”,订阅制是“零售”,广告是“补贴”,企业服务是“定制” 。

| 模式 | 适合人群 | 定价依据 | 优势 | 劣势 |

|---|---|---|---|---|

| API调用 | 开发者/企业 | Token消耗量 | 按需付费、公平 | 用量波动大、预测难 |

| 订阅制 | 个人/轻量用户 | 固定周期 | 收入稳定 | 成本倒挂风险 |

| 广告模式 | 免费用户 | 广告展示 | 覆盖大规模免费用户 | 可能影响体验 |

| 企业服务 | B端客户 | 项目/效果 | 客单价高、粘性强 | 定制成本高 |

六、代码示例演示:计算API调用成本

以下示例展示如何估算AI助手应用的API成本,并在用户请求时进行预算控制。

import time from dataclasses import dataclass from typing import Dict @dataclass class ModelPricing: """模型定价配置(2026年3月数据)""" input_price_per_million: float 美元/百万Token output_price_per_million: float 主流模型定价映射 MODEL_PRICES: Dict[str, ModelPricing] = { "gpt-5": ModelPricing(5.00, 15.00), "claude-sonnet-4.6": ModelPricing(3.00, 15.00), "claude-opus-4.6": ModelPricing(15.00, 75.00), "deepseek-v3": ModelPricing(0.28, 1.10), "qwen-3": ModelPricing(0.28, 0.83), "doubao-2.0": ModelPricing(0.11, 0.28), } def calculate_cost(model: str, input_tokens: int, output_tokens: int) -> Dict: """计算单次API调用的成本""" pricing = MODEL_PRICES.get(model) if not pricing: raise ValueError(f"Unknown model: {model}") input_cost = (input_tokens / 1_000_000) pricing.input_price_per_million output_cost = (output_tokens / 1_000_000) pricing.output_price_per_million return { "model": model, "input_tokens": input_tokens, "output_tokens": output_tokens, "input_cost": round(input_cost, 6), "output_cost": round(output_cost, 6), "total_cost": round(input_cost + output_cost, 6), } 模拟一次Agent复杂任务:输入含上下文检索内容约5000 Token,模型回答约2000 Token result = calculate_cost("claude-sonnet-4.6", input_tokens=5000, output_tokens=2000) print(f"单次Agent调用成本: ${result['total_cost']:.4f}") print(f"月调用1000次成本: ${result['total_cost'] 1000:.2f}")

这段代码的核心价值在于:当你为AI助手应用设计定价策略时,可以基于模型定价、Token消耗量、调用频次三要素构建自己的计费公式。

七、底层原理与技术支撑

AI助手盈利模式的技术基础,在于Token计费机制与成本控制技术。

Token是什么?Token是大模型处理文本的最小单位,一个英文单词约1-2个Token,一个中文字符约1-3个Token。API按Token计费,本质是“按计算量付费”。

决定模型定价差异的技术因素包括:GPU算力成本、集群利用率、模型架构复杂度、工程优化水平-。这也是为什么2026年初出现大模型集体涨价潮——国内日均Token消耗从2025年中的30万亿飙升至2026年2月的180万亿,算力成本迫使价格回归商业价值-。

技术层面的另一个关键点是RAG(Retrieval-Augmented Generation,检索增强生成)vs 模型微调(Fine-tuning) 的成本选择。RAG通过实时检索外部知识库来增强模型回答,适合动态数据场景,成本比微调低约90%-41。微调则需重新训练模型参数,前期投入大但单次查询成本稳定。理解这一取舍,直接关系到AI助手产品的成本优化策略。

八、高频面试题与参考答案

Q1:AI助手的主要盈利模式有哪些?各有什么优缺点?

标准答案:主要模式有四类。①API按Token计费——公平透明,适合开发者,但用量预测困难;②订阅制——收入稳定,但重度用户可能导致亏损;③广告支持——覆盖免费用户,可能影响体验;④企业定制/RaaS——客单价高,但定制成本大。主流AI平台通常组合使用多种模式。

Q2:为什么API要按Token计费?Token是什么?

标准答案:Token是大模型处理文本的最小单位,按Token计费本质是“按计算量付费”。相比按请求次数或按字符数计费,Token能更准确地反映实际算力消耗,因为不同的提示词复杂度、生成长度对应的计算量差异显著。

Q3:RAG和模型微调在成本上有什么差异?如何选型?

标准答案:RAG成本与检索基础设施挂钩,适合动态知识场景,成本可比微调低约90%;微调需要GPU训练资源和标注数据,前期投入大但单次查询成本稳定。动态数据优先RAG,静态高精度任务优先微调,混合架构可实现最优效果-41-。

Q4:2026年AI助手盈利模式呈现哪些新趋势?

标准答案:①定价颗粒度从订阅/席位向实际消耗量迁移;②按效果付费的RaaS模式兴起;③广告模式正式进入大模型产品;④企业级市场成为主要收入来源,预计2025年企业级AI Agent年收入接近130亿美元-54。

九、结尾总结

回顾全文,AI助手盈利并非单一模式,而是一套API调用+订阅制+广告模式+企业服务的组合方案。核心要点可归纳为:

Token是计价基础——理解Token计费机制是理解盈利模式的起点

模式组合是常态——头部平台如OpenAI、Google、Anthropic均采用多模式并行的策略

成本控制是命门——RAG、缓存等工程化手段直接决定盈利能力

2026年是分水岭——AI产业正从“烧钱抢市场”转向“价值兑现期”-

关于AI助手的更多技术细节,如Agent架构设计、大模型部署优化、推理成本压降策略等内容,将在后续文章中展开讲解。欢迎持续关注。