2026年4月10日

独家视角|本文结合2026年最新技术动态,首次系统性拆解AI漫画PV助手的技术架构、底层原理与实战代码,深度覆盖面试高频考点,为从入门到进阶的技术创作者提供完整知识链路。

2026年,AI漫剧赛道彻底爆发——巨量引擎数据显示,2024年第四季度抖音漫剧付费规模尚不足3000万元,而预测2025年全年将达到200亿元-49。“零经验也能入场”“3人团队月产5部”“制作成本从每分钟上千元砍至几十元”成为2026年AI漫剧赛道的真实写照-49。在这场“技术平权”引发的创业狂欢背后,一个关键角色正从幕后走向台前——AI漫画PV助手(AI Comic Promotion Video Assistant)。它正以惊人的效率,将传统需要多人协作、耗时8-12小时的漫画PV制作流程,压缩至30分钟以内-1。对于技术入门者、在校学生乃至面试备考者而言,理解AI漫画PV助手的底层逻辑、核心技术与工程实践,不仅是跟上行业趋势的必修课,更是构建AIGC领域完整知识链路的关键一环。

本文将从痛点切入,系统讲解核心概念、技术原理、代码实现与高频面试要点,帮助读者由浅入深地建立AI漫画PV助手的完整认知体系。

一、痛点切入:传统漫画PV制作为何如此“难产”?

在理解AI漫画PV助手的价值之前,我们先来看看传统漫画PV制作流程的全貌。

传统流程拆解

一个标准的漫画PV(Promotion Video,宣传视频)制作,通常需要经历以下环节:

剧本改编:将小说/文案手动转化为分镜脚本

角色/场景设计:依赖专业美术绘制角色设定与场景原画

分镜绘制:手动排版布局,绘制每一帧的画面草图

上色与精修:对每个分镜进行精细上色和细节打磨

动态合成:使用PR/AE等剪辑软件手动添加转场、特效、字幕

配音与导出:配音录制、音画对齐、多平台格式适配

每个环节都需要专业人员的深度参与——从编剧、美术师、分镜师到后期剪辑师,单集制作耗时通常在8-12小时,普通创作者难以规模化产出-1。

传统模式的“三座大山”

传统漫剧PV制作面临三大核心痛点:

| 痛点维度 | 具体表现 |

|---|---|

| 效率低 | 依赖人工逐步完成各环节,串行工作导致周期长 |

| 成本高 | 专业美术人员成本昂贵,单页漫画成本可达50-300美元-11 |

| 门槛高 | 需要同时掌握剧本创作、绘画、剪辑等多技能 |

正是这三座大山,催生了AI漫画PV助手的出现。通过将AI编排引擎与模块化技能相结合,AI漫画PV助手实现了“剧本输入→全流程自动化→PV输出”的闭环,单集制作时间压缩至30分钟,零美术基础也能量产高质量漫剧-1。

二、核心概念讲解:什么是AI漫画PV助手?

定义与内涵

AI漫画PV助手(AI Comic Promotion Video Assistant) ,是指利用人工智能技术(包括大语言模型、多模态生成模型、智能编排引擎等)辅助或全自动完成漫画宣传视频制作的一类工具或系统。它的核心使命是:将文字故事转化为带有动态效果、配音字幕的漫画风格视频,无需或仅需极少量人工干预-2。

拆解这个定义中的几个关键词:

“AI” :底层依赖大语言模型(LLM,Large Language Model)、文生图模型(Text-to-Image Model)、图生视频模型(Image-to-Video Model)等多模态AI技术

“PV” :Promotion Video的缩写,指宣传视频,特点是时长短、节奏快、视听冲击力强

“助手” :强调工具的辅助性定位——AI不是取代创作者,而是降低技术门槛、提升生产效率

一个生活化类比

可以把AI漫画PV助手理解为一支“全自动交响乐队”。传统漫画PV制作像是请一位作曲家写总谱、再请几十位乐手各自练习、最后凑到一起排练——耗时且需要大量专业资源。而AI漫画PV助手就像把整支乐队“智能集成”到了一个黑盒子里:你只需哼一段旋律(输入剧本),它就能自动完成编曲、配器、排练、录音,最终直接输出一首完整的交响乐。

三、关联概念讲解:LLM智能体与ComfyUI

理解了AI漫画PV助手的整体概念后,我们来看支撑它的两个关键角色:LLM智能体与ComfyUI。

LLM智能体(LLM Agent)

LLM智能体是指基于大语言模型构建的、具备任务拆解、工具调用、多步骤执行能力的自主系统。在AI漫画PV助手的语境下,它扮演“大脑”的角色-40。

它的核心能力包括:

任务拆解:将“制作一集漫画PV”这个大目标,拆解为“生成剧本→生成分镜→生成图片→生成视频→配音合成→导出成品”等子任务

工具调用:按需调用文生图模型、视频生成模型、语音合成模型等工具

流程编排:管理各任务的执行顺序、数据流转与异常处理

ComfyUI

ComfyUI是一个节点式的本地AIGC(AI Generated Content,AI生成内容)引擎,它通过可视化的节点连接来构建复杂的图像/视频生成工作流。在AI漫画PV助手中,它扮演“双手”的角色-24。

ComfyUI的核心优势在于:

支持Flux、SDXL(Stable Diffusion XL,稳定扩散XL模型)、LTX-2.3等顶级模型-24

通过IP-Adapter + ControlNet技术栈,解决了AI漫画最头疼的“角色一致性”问题-24

可导出API接口,供LLM智能体远程调用

两者的关系

一句话总结:LLM智能体是“大脑”,负责思考与调度;ComfyUI是“双手”,负责执行与渲染。两者协同,构成AI漫画PV助手的核心运行骨架-24。

| 维度 | LLM智能体 | ComfyUI |

|---|---|---|

| 角色定位 | 大脑(调度层) | 双手(执行层) |

| 核心能力 | 任务拆解、流程编排、工具调用 | 图像生成、视频合成、角色一致性控制 |

| 技术输出 | 结构化指令(JSON) | 图片/视频文件 |

| 关注点 | 逻辑正确性 | 画面质量与一致性 |

四、概念关系与区别总结

AI漫画PV助手的完整技术体系中,各层概念的关系可以这样理解:

┌─────────────────────────────────────────┐ │ AI漫画PV助手(整体方案) │ ├─────────────────────────────────────────┤ │ ┌─────────────┐ ┌─────────────────┐ │ │ │ LLM智能体 │ │ ComfyUI │ │ │ │ (调度层) │→│ (执行层) │ │ │ └─────────────┘ └─────────────────┘ │ │ ↓ ↓ │ │ ┌──────────────────────────────────┐ │ │ │ IP-Adapter / ControlNet / LoRA │ │ │ │ (核心技术组件) │ │ │ └──────────────────────────────────┘ │ └─────────────────────────────────────────┘

一句话记忆:AI漫画PV助手 = LLM智能体做调度 + ComfyUI做执行 + 一致性技术保质量。

五、代码/流程示例:构建一条极简AI漫画PV流水线

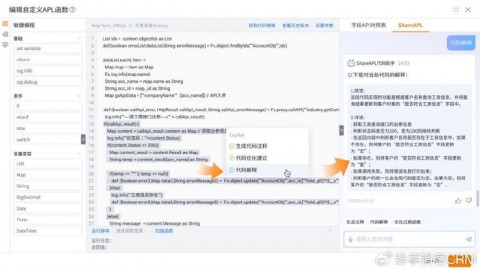

以下是一个精简但可运行的AI漫画PV自动化工作流示例,使用Dify(可视化Workflow平台)作为编排引擎,ComfyUI作为生成引擎。

步骤一:Dify Workflow定义(剧本与分镜自动生成)

// 输入:故事大纲 // 输出:结构化JSON分镜脚本 { "episodes": [ { "episode_id": 1, "scenes": [ { "scene_id": 1, "duration": 5, "prompt": "A young girl in a ruined city, looking at the sunset, anime style, consistent character ID: hero_001", "dialogue": "这个世界,还有希望吗?", "camera_motion": "zoom_in" } ] } ] }

关键点:分镜脚本必须采用结构化JSON格式。如果不给模板,AI写出来的剧本格式千奇百怪,无法直接喂给下游图片生成工具-2。

步骤二:Dify调用ComfyUI生成分镜图片

ComfyUI API调用示例 import requests import json 加载ComfyUI工作流JSON with open('comic_workflow_api.json', 'r') as f: workflow = json.load(f) 替换提示词节点 workflow['6']['inputs']['text'] = scene_prompt 填入分镜描述 添加角色一致性控制 ipadapter_config = { "model": "ip-adapter-plus-face_sd15.safetensors", "weight": 0.85, 参考图权重 "reference_image": "hero_001_ref.png" 角色参考图 } 发送请求到ComfyUI response = requests.post( "http://127.0.0.1:8188/prompt", json={"prompt": workflow} )

核心配置解读:

weight: 0.85:参考图权重控制在0.7-0.9之间,既能保持角色特征,又避免过拟合-2reference_image:为每个主要角色准备3-5张不同角度的参考图,存入角色库,每次生成时自动引用-2

步骤三:图生视频 + 配音合成

使用LTX2.3模型将分镜大图转为视频 ltx_config = { "input_image": "20_panel_storyboard.png", 20宫格分镜大图 "input_audio": "dialogue_001.wav", 配音音频 "video_length": 60, 60秒视频 "motion_strength": 3.5, 运动强度 "resolution": "9:16" 竖屏适配 }

技术亮点:ComfyUI + LTX2.3的20宫格工作流,能将20个分镜一次性变成1分钟连贯漫剧视频,全程本地运行、免费无限制、支持音画同步和唇部对齐-6。传统模式需要一张一张图处理,现在一张大图一次性搞定。

新旧流程对比

| 对比维度 | 传统人工模式 | AI漫画PV助手模式 |

|---|---|---|

| 角色一致性 | 人工反复修正 | IP-Adapter自动锁定 |

| 分镜生成 | 逐格手绘 | 批量生成20宫格 |

| 动态合成 | PR/AE手动添加 | LTX2.3一键生成 |

| 单集耗时 | 8-12小时 | 30分钟 |

六、底层原理与技术支撑

AI漫画PV助手的能力并非凭空而来,其底层依赖多个关键技术组件的协同。

核心底层技术栈

| 技术层级 | 核心技术 | 作用 |

|---|---|---|

| 模型层 | 大语言模型(LLM) | 剧本解析、任务拆解、流程编排 |

| 文生图模型(Flux/SDXL) | 漫画风格图像生成 | |

| 图生视频模型(LTX2.3/SVD) | 静态图像转动态视频 | |

| 语音合成模型(TTS) | 配音生成与唇部对齐 | |

| 工程层 | 编排引擎 | 任务调度、流程控制 |

| 节点式工作流 | 可视化搭建生成管线 | |

| API网关 | 模型与工具的标准化调用 | |

| 控制层 | IP-Adapter | 角色特征锁定 |

| ControlNet | 姿态与构图控制 | |

| LoRA | 风格微调适配 |

角色一致性:最硬核的技术挑战

AI漫画PV助手中最核心的技术难点是角色一致性——如何确保主角在每一帧中长得一样,而不是“千人千面”。

解决方案采用 “固定特征库+控制网”的双重保险策略-22:

IP-Adapter:以角色的“三视图”作为参考底图,锁定角色面部特征与整体风格-22

FaceID/InstantID:专门锁定脸部特征,确保五官一致-2

ControlNet:控制角色的姿态和构图布局-2

LoRA:对模型进行微调,适配特定角色的独特风格-2

这套组合拳的核心原理是:AI绘图模型的本质是基于概率的“联想者”,而非基于逻辑的“画师”-22。要驯服这种概率,不能依赖复杂的提示词,而要通过参考图和控制网络“硬约束”生成结果。

底层依赖知识点

AI漫画PV助手的技术实现,高度依赖以下底层知识点:

Transformer架构:LLM和多模态模型的基础

扩散模型(Diffusion Model) :文生图与图生视频的核心算法

注意力机制:IP-Adapter等特征控制技术的数学基础

微调技术(LoRA等) :模型适配与风格定制的关键

七、高频面试题与参考答案

以下是AI漫画PV助手及相关技术栈的5道经典面试题,涵盖不同难度层次。

1. 什么是AI漫画PV助手?它的核心价值是什么?

参考答案:

AI漫画PV助手是利用大语言模型、多模态生成模型和智能编排引擎,辅助或全自动完成漫画宣传视频制作的工具系统。其核心价值是解决传统漫画PV制作的“效率低、成本高、门槛高”三大痛点,通过自动化工作流将单集制作时间从8-12小时压缩至30分钟以内。

踩分点:概念定义准确 + 痛点意识 + 量化效率提升

2. 在AI漫画PV助手中,如何解决角色一致性问题?

参考答案:

采用“固定特征库+控制网”的双重保险策略:

使用IP-Adapter锁定角色整体风格

使用FaceID/InstantID锁定脸部特征

使用ControlNet控制姿态和构图

可选LoRA进行模型微调

为每个主要角色准备3-5张不同角度的参考图,存入角色库

踩分点:技术组件列举完整 + 说明原理(概率联想 vs 逻辑约束)+ 给出量化配置建议

3. 简述Dify + ComfyUI方案在AI漫画PV制作中的分工。

参考答案:

Dify作为可视化Workflow/Agent平台,负责“思考+编排”——自动生成剧本、分镜脚本、优化提示词,并进行多Agent协作调度。ComfyUI作为节点式本地AIGC引擎,负责“执行+渲染”——接收Dify的指令,通过IP-Adapter和ControlNet保证角色一致性,生成图片和视频。两者组合实现“输入故事大纲 → 输出完整漫剧视频”的全链路自动化。

踩分点:分工明确(大脑 vs 双手)+ 各自技术特性 + 协作流程清晰

4. AI漫画PV助手中,ComfyUI的节点式工作流相比传统顺序脚本有什么优势?

参考答案:

可视化编排:降低使用门槛,非技术用户也能搭建生成管线

灵活复用:节点组合可保存为模板,一次搭建多次使用

并行执行:独立节点可并行运行,提升生成效率

可插拔架构:可随时替换节点(如切换不同的文生图模型),模块化程度高

导出API:支持将工作流导出为API,供外部系统调用

踩分点:至少答出3个优势 + 与传统模式的对比意识

5. 请解释IP-Adapter在AI漫画PV助手中的工作原理。

参考答案:

IP-Adapter(Image Prompt Adapter,图像提示适配器)是一种将参考图像特征注入扩散模型的轻量级适配模块。它通过在原有扩散模型的交叉注意力层中增加额外的图像特征通道,使得模型在生成时既能遵循文本提示词,又能保持参考图像的关键视觉特征。在漫画PV场景中,只需提供角色的参考图,IP-Adapter即可确保后续所有生成的图像中角色面部、服装保持一致,权重参数通常设置在0.7-0.9之间以达到最佳平衡。

踩分点:原理表述准确(注意力机制层面)+ 应用场景说明 + 配置参数意识

八、结尾总结

核心知识点回顾

本文从AI漫画PV助手的概念出发,系统梳理了以下核心内容:

问题根源:传统漫画PV制作面临效率低、成本高、门槛高三大痛点

核心概念:AI漫画PV助手 = LLM智能体(大脑)+ ComfyUI(双手)

关键技术:IP-Adapter/ControlNet/LoRA解决角色一致性;节点式工作流实现模块化编排

实战代码:Dify + ComfyUI的完整调用流程,20宫格工作流配置

面试要点:5道高频题的规范答案与踩分逻辑

重点与易错点提示

| 类型 | 内容 |

|---|---|

| 务必掌握 | 角色一致性的技术方案(IP-Adapter + FaceID + ControlNet + LoRA) |

| 常见误区 | 误以为“写好提示词就能保证角色一致”——实际需要参考图+控制网络双重约束 |

| 易混淆概念 | LLM智能体(调度)vs ComfyUI(执行),Dify(编排平台)vs Dify Agent(具体Agent节点) |

进阶预告

本文聚焦于AI漫画PV助手的核心概念、技术原理与基础实践。后续文章将深入探讨:

LLM智能体的任务拆解与流程编排深度优化

ComfyUI高级工作流设计与性能调优

多模型协同的工程化架构与部署方案

AI漫画PV助手的商业模式与变现路径

一句话总结:AI漫画PV助手正在重塑内容创作的生产力边界——理解它的原理,就等于拿到了进入AIGC工业化的第一张门票。

本文数据截止至2026年4月10日,部分技术参数与工具版本可能随时间更新,建议结合官方文档进行验证。