本文首发于2026年4月9日 · 核心技术科普

在电商平台纷纷拥抱AI的时代,亚马逊推出的生成式AI购物助手Rufus正在重塑商品发现的方式。本文将系统讲解亚马逊AI助手背后的Agentic AI架构、知识图谱技术及底层原理,面向技术学习者提供完整知识链路。

一、痛点切入:传统为什么不够用?

传统的工作方式

传统的电商遵循“关键词匹配”范式:用户输入关键词 → 系统在商品数据库中执行精确匹配或模糊匹配 → 按相关性排序返回结果。

下面是一个极简的传统示意代码:

传统关键词匹配示例 def keyword_search(query: str, product_db: list) -> list: query_terms = query.lower().split() results = [] for product in product_db: 匹配关键词是否出现在标题或描述中 match_score = sum( term in product['title'].lower() or term in product['desc'].lower() for term in query_terms ) if match_score > 0: results.append((product, match_score)) 按匹配分数排序 results.sort(key=lambda x: x[1], reverse=True) return [p for p, _ in results] 示例:"结婚穿的鞋" products = [ {'title': '黑色正装皮鞋', 'desc': '商务男士正装鞋'}, {'title': '白色运动跑鞋', 'desc': '轻便缓震跑步鞋'}, ] print(keyword_search('结婚穿的鞋', products)) 输出:[] —— 没有任何匹配结果

传统的三大痛点

语义鸿沟:传统只能匹配文字,无法理解“结婚穿的鞋”意味着“正式、皮质、非运动”这类常识推理。当用户“孕妇穿的鞋”时,系统不会主动推荐“防滑鞋”,除非关键词完全一致。

意图缺失:用户“高尔夫一日所需”,传统只返回包含这些词的页面,而不是整合球杆、球鞋、手套等完整装备方案。

上下文无记忆:每次都是独立行为,无法根据用户历史偏好持续优化推荐。

二、核心概念讲解:COSMO(常识知识图谱)

定义

COSMO(Common Sense Knowledge Generation and Serving System,常识知识生成与服务系统) 是亚马逊自研的大规模AI框架,用于构建覆盖电商场景的常识知识图谱。它通过大型语言模型生成数百万条知识断言,经人工闭环标注验证后,注入亚马逊的推荐系统。

生活化类比

想象一位经验丰富的实体店导购:当你走进鞋店说“要买一双孕期的鞋子”,她不会追问“你要什么颜色”,而是立刻明白你需要的是“防滑、舒适、一脚蹬”的鞋——这就是常识推理。COSMO要做的事,就是把这套常识“教”给AI系统。

COSMO的核心价值

COSMO通过构建实体-关系-实体三元组来编码常识知识。例如:<防滑鞋,适用于人群,孕妇> 或 <相机包+屏幕保护膜,组合功能,保护相机>。这类关系传统知识图谱无法捕捉,但对购物决策至关重要-1。

在亚马逊内部A/B测试中,COSMO使相关性提升了60%(macro F1指标),并带来0.7%的销售额提升——在10%的流量测试中,这一数字对应年化数亿美元增量-1。

三、关联概念讲解:Rufus(AI购物助手)

定义

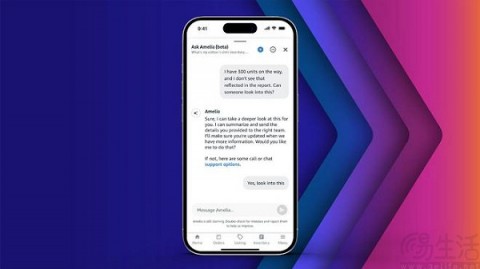

Rufus 是亚马逊基于Amazon Bedrock构建的生成式AI对话购物助手,用户可以在亚马逊App和网站中以自然语言提问、比较产品、获取个性化推荐-5。

Rufus并不是一个单一的聊天机器人,而是五个独立AI系统的协同组合-5:

| 组件 | 说明 |

|---|---|

| 大语言模型 | 通过Amazon Bedrock接入Anthropic Claude Sonnet、Amazon Nova及亚马逊自研模型 |

| COSMO知识图谱 | 提供常识推理能力,理解用户购物意图 |

| RAG检索增强 | 从权威来源(NYT、USA Today等)获取信息,提升答案准确性 |

| 即时路由器 | 灵活选择最合适的模型处理不同类型查询 |

| 记忆系统 | 账户级记忆,理解家庭结构、个人偏好及购买历史 |

Rufus的核心能力

截至2026年初,Rufus已覆盖美国、英国、德国、法国、意大利、西班牙、加拿大和印度8个市场,超过3亿用户使用过该功能-8。2025年11月,亚马逊宣布对Rufus进行超过50项技术升级,新增账户记忆、价格追踪、自动购买(Rufus Auto-buy)等功能--8。

四、概念关系与区别总结

COSMO与Rufus是“知识底座”与“应用界面” 的关系:

一句话总结:COSMO是Rufus的“大脑”,Rufus是COSMO的“嘴巴”——一个负责理解“用户真正想要什么”,一个负责用自然语言把答案讲出来。

| 对比维度 | COSMO | Rufus |

|---|---|---|

| 本质 | 知识图谱系统 | 对话交互助手 |

| 角色 | 后台数据层 | 前端应用层 |

| 输入 | 商品数据 + 用户行为 | 自然语言问题 |

| 输出 | 意图映射 + 关系推理 | 对话式回答 + 商品推荐 |

| 依赖 | 大模型生成 + 人工标注 | COSMO + LLM + RAG |

Rufus使用COSMO知识图谱进行语义理解,再结合LLM生成自然语言响应。Rufus不是取代传统,而是在其之上增加一个对话式交互层——传统被封装为一个工具,由Agentic AI层负责调用-4。

五、代码示例:RAG的原理演示

Rufus的核心技术之一就是RAG(Retrieval-Augmented Generation,检索增强生成) 。以下是一个简化的RAG演示:

RAG模式简化演示 from typing import List, Dict class SimpleRAGSearch: def __init__(self, product_db: List[Dict], knowledge_graph: Dict): self.product_db = product_db 商品数据库 self.knowledge_graph = knowledge_graph 常识知识图谱(模拟COSMO) def retrieve(self, user_query: str) -> List[Dict]: """第一步:检索 - 基于意图而非纯关键词匹配""" 利用知识图谱进行意图扩展 intent_terms = self.knowledge_graph.get(user_query, [user_query]) results = [] for product in self.product_db: 计算语义相似度(实际使用向量化embedding) score = self._semantic_score(product, intent_terms) if score > 0.5: results.append({'product': product, 'score': score}) results.sort(key=lambda x: x['score'], reverse=True) return results[:5] 取Top-5 def generate(self, query: str, retrieved_products: List[Dict]) -> str: """第二步:生成 - 将检索结果组织为自然语言回答""" if not retrieved_products: return f"抱歉,没有找到与「{query}」完全匹配的商品。要不要换个说法试试?" product_names = [p['product']['title'] for p in retrieved_products[:3]] return f"根据你的需求「{query}」,推荐:{', '.join(product_names)}。" def ask(self, query: str) -> str: """RAG完整流程:检索 → 增强 → 生成""" retrieved = self.retrieve(query) return self.generate(query, retrieved) 使用示例 knowledge = { '孕妇穿的鞋': ['防滑鞋', '平底鞋', '一脚蹬'], '结婚穿的鞋': ['正装皮鞋', '高跟鞋', '礼鞋'], } products = [ {'title': '家用防滑浴室拖鞋', 'category': '家居'}, {'title': '孕期舒适平底鞋', 'category': '女鞋'}, {'title': '商务正装皮鞋', 'category': '男鞋'}, ] rag = SimpleRAGSearch(products, knowledge) print(rag.ask('孕妇穿的鞋')) 输出:根据你的需求「孕妇穿的鞋」,推荐:孕期舒适平底鞋, 家用防滑浴室拖鞋。

执行流程说明:用户提问 → 知识图谱将查询意图扩展为相关商品特征 → 检索层匹配商品 → 生成层组织自然语言回复。

六、底层原理与技术支撑

1. Agentic AI架构

Rufus围绕Agentic AI架构构建。与传统LLM“文字进文字出”的模式不同,Agentic AI让系统能够:接收自然语言请求 → 制定行动计划 → 调用专门工具执行子任务 → 综合结果返回-4。

亚马逊机器学习副总裁Rajeev Rastogi指出:“LLM不能解决所有问题,它们无法解决优化问题。未来将有专门引擎和工具擅长特定任务,LLM将调用这些工具——这正是Agentic AI的用武之地。 ”-4

2. 多模型路由

Rufus采用即时路由器技术,根据查询类型动态选择最合适的模型——简单问题用轻量模型快速响应,复杂推理用高能力模型处理,在延迟和答案质量间达到最优平衡-2。

3. Amazon Bedrock全托管服务

Rufus构建在Amazon Bedrock之上——这是AWS的全托管基础模型服务,支持通过统一API接入多种领先LLM。Bedrock提供模型选择、微调、RAG和Agent能力编排,是Rufus规模化支撑数亿用户的基石-5。

核心原理支撑关系:Agentic AI负责任务编排 → 多模型路由做模型调度 → Bedrock提供底层模型服务 → 后端依赖Transformer架构(自注意力机制)处理序列数据。后续可以深入展开Transformer原理和LLM训练机制。

七、高频面试题与参考答案

Q1:Rufus与传统亚马逊(A9算法)的本质区别是什么?

参考答案要点:

传统A9:关键词匹配 + 相关性排序,回答“有哪些商品包含这个关键词”。

Rufus:Agentic AI架构 + 多模型协同 + RAG + COSMO知识图谱,理解“用户真正的购物意图”,提供对话式推荐和个性化服务。传统被封装为Rufus的一个工具-4。

Q2:COSMO解决了什么核心问题?它与知识图谱(Knowledge Graph)有何不同?

参考答案要点:

核心问题:传统知识图谱只记录产品客观属性(品牌、颜色、材质),但无法捕捉“孕妇需要防滑鞋”这类常识推理。COSMO将这些常识连接编码为实体-关系三元组-1。

与传统KG区别:传统KG依赖人工构建,规模受限;COSMO由大模型生成数百万断言 + 人工闭环标注验证,能持续扩展。

Q3:RAG在Rufus中扮演什么角色?为什么需要RAG?

参考答案要点:

作用:RAG让Rufus在生成答案前先从权威数据源(产品目录、客户评论、权威评测媒体)检索相关信息,再将检索结果作为上下文输入LLM生成最终回答-2。

为什么需要:单纯依赖LLM的训练数据会导致“幻觉”——编造不存在的产品或事实。RAG将回答锚定在实时、可验证的信息源上,大幅提升准确性。

Q4:Rufus的账户记忆功能是如何实现的?

参考答案要点:

系统记录用户的浏览历史、购买记录、偏好和家庭结构信息,构建用户画像向量。

每次查询时,该用户画像向量与COSMO知识图谱协同检索,实现个性化商品推荐。

技术上可能结合向量数据库(如Amazon S3 Vectors)存储和检索用户画像,基于Transformer架构计算语义相似度。

Q5:如果想从事Rufus这类AI助手开发,需要掌握哪些技术栈?

参考答案要点:

基础:Python/Java、数据结构与算法、分布式系统

ML核心:LLM原理(Transformer)、RAG架构、向量检索、模型微调

AWS生态:Amazon Bedrock、SageMaker、S3 Vectors

系统设计:Agentic AI任务编排、多模型路由、低延迟推理架构

八、结尾总结

本文系统讲解了亚马逊AI助手Rufus背后的关键技术体系:

| 知识点 | 核心结论 |

|---|---|

| 传统痛点 | 关键词匹配无法理解用户意图 |

| COSMO | 常识知识图谱,编码真实购物逻辑 |

| Rufus | 基于Agentic AI的对话式购物助手 |

| 二者关系 | COSMO是知识底座,Rufus是应用界面 |

| 核心技术栈 | Agentic AI + 多模型路由 + RAG + Bedrock |

面试重点:Rufus vs A9的区别、COSMO解决什么问题、RAG的作用、Agentic AI架构的优势。

下一篇预告:我们将深入Transformer自注意力机制,拆解LLM如何理解自然语言,并展示如何在本地搭建简易版RAG系统。

参考资料

Amazon COSMO:大规模电商常识知识生成与服务系统(SIGMOD 2024)-1

Amazon Rufus官方介绍,aboutamazon.com,2025年11月-59

Amazon Rufus百度百科,2026年2月-8

Digit.in:Rajeev Rastogi谈Rufus背后的Agentic AI,2026年3月-4

Zonguru:Amazon Rufus完整指南,2026年3月-5

Zonguru:Amazon COSMO完整指南,2026年3月-1

亚马逊台湾官方:Rufus AI购物助理升级介绍,2026年1月-2