花几百万买回来的“祖宗”,到底是谁的锅?

上周跟一个搞智能制造的老哥吃饭,他那个脸色,比他们厂里生产线上刚出炉的铸铁件还黑。

“气死我了,去年年底拍板上了20台AI服务器,说是能跑工业大模型,结果呢?现在连个瑕疵检测都跑不利索,动不动就降频,研发那边天天骂IT是‘花钱买罪受’。”他猛灌了一口啤酒,“我找当时卖我机器的那个代理商,人家两手一摊,说是我机房的电和空调不行,这不扯吗?下单的时候可是拍胸脯说能上‘满血版’的!”

我听完就笑了。这哪是买服务器啊,这分明是买了个“祖宗”回来供着。

其实这老哥踩的坑,在2026年的今天,真的不在少数。咱们总以为AI服务器这玩意儿,只要有钱,去网上搜个配置单,找个看起来靠谱的渠道商下单就完事了。但现实往往很骨感——你买回来的可能不是算力,而是一个发热巨大、网络卡顿、根本跑不起来理论的“铁疙瘩”。

这就引出了今天要聊的核心话题:咱们到底该怎么挑那些真正能办事的AI服务器代理商?

市场火得一塌糊涂,但“水”也越来越深

这年头,你要是没听说过AI服务器,那你可能刚从火星回来。我翻了翻最近的市场数据,全球AI服务器市场规模今年已经奔着2260亿美元去了,光咱们国内,去年就干了将近2300亿人民币的规模 -7。你看那些大厂,像什么广达、纬颖,砸起钱来眼睛都不眨一下,动辄上百亿的资本支出往里扔,就为了扩产AI服务器 -1。

但这热闹是他们的,落到咱们普通企业头上,就只剩下头疼。

为啥?因为现在的AI服务器,早就不光是比谁的显卡多了。一台真正的顶级AI服务器,它就是个“电老虎”加“火炉子”。 你看现在单张GPU功耗动不动就上千瓦,整柜(Rack)跑起来,那散热压力能把传统机房的风冷系统直接干崩溃 -5。如果你找的代理商只懂卖硬件,不懂散热和机房环境规划,那你的GPU利用率大概率只能趴在60%,剩下的40%不是在算数,是在“等红灯”——等温度降下来,等网络数据传过来 -5。

那到底咋整?难道我们就得认栽吗?

把“代理商”当“军师”,这钱才花得值

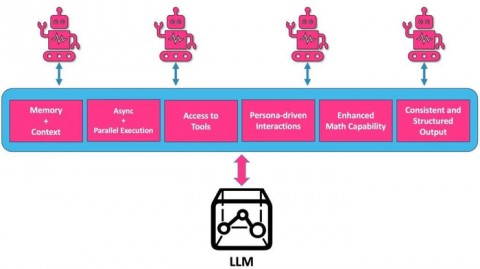

其实,问题的关键就在于AI服务器代理商的定位变了。以前他们是“搬运工”,把货从厂家搬到你手里。现在,他们必须得是“军师”,得懂你的业务,懂你的机房,甚至得懂你未来三年的发展。

我最近跟几个圈里的朋友聊,总结出2026年挑AI服务器代理商的三个“硬指标”,全都是真金白银换来的教训:

第一,看它懂不懂“散热”。

别笑,这是真的。现在的AI服务器,特别是那种要跑大模型训练的,液冷几乎是标配 -7。有些代理商还在给你推那种风冷的老旧方案,说“够用了”。兄弟,千万别信!因为一旦你的机柜形成“局部热点”,芯片为了保护自己就会自动降频。你花几十万买的算力,瞬间就变成了“阉割版”。真正专业的代理商,会在你下单前,派工程师去量你的机柜尺寸,算你的PUE值,甚至给你出液冷改造方案。这种服务,才叫值回票价。

第二,看它懂不懂“网络”。

你想啊,你买一堆GPU回去,它们之间要是没法高速聊天,那就是一堆散沙。大模型训练是要做“并行计算”的,如果跨节点通信的带宽不够,你的GPU就只能干等着数据传过来,这叫“网络墙” -5。现在牛逼的集群,内部走的都是400G甚至800G的无阻塞网络。如果你找的代理商只会跟你吹“我们这是多少核的CPU”,却说不清网卡和交换机的型号,那赶紧换人。

第三,看它懂不懂“落地”。

这一点最实在。就像开头我那个老哥,他需要的是能解决产线瑕疵检测的方案,不是买个裸机回来自己折腾。好的AI服务器代理商,能给你讲清楚,这台机器到底是用来做“训练”的还是做“推理”的。别小看这个,训练型服务器贵得要死,但如果你是跑成熟的应用(比如企业知识库、视觉检测),推理型服务器可能就能搞定,价格却便宜一大截 -7-8。最近有个叫奇点国峰的公司,签了个2.78亿的大单,卖200台AI服务器,每台将近140万。这种大单背后,靠的绝对不是低价,而是能提供从上游芯片(比如国产的沐曦GPU)到下游交付的一整套软硬一体化方案 -6-10。这才是企业想要的——拿来就能用,用了就能产生效益。

选对了人,才算真正上了牌桌

说实话,现在这波AI浪潮,对于咱们普通企业来说,有点像当年互联网刚兴起那会儿。大家都在摸着石头过河,谁也不想掉队。

但我始终觉得,技术再高深,最终还是要为人服务。买AI服务器这件事,本质上买的是“服务”,是“安心”。咱们花钱,不就是图个省心吗?机器出问题有人管,跑不动了有人优化,这才是好代理商的真正价值。

别被那些只会念PPT、背参数的人忽悠了。下次再去聊,你就问他三句话:“我现在的机房放你这机器会不会烧?”、“我这几台机器怎么连才能跑满速?”、“买回去之后,我那个具体的小程序到底能不能快点?” 这三个问题一问,是骡子是马,立马现形。

网友互动问答环节

网友“山城棒棒军”问:

我是重庆一家中小制造企业的IT负责人,预算只有150万左右,想上AI做质检。我看网上那些顶配的服务器动辄几百万,感觉我们这种小企业是不是根本玩不起AI?有没有什么“丐版”方案推荐?

答:

哎哟,兄弟,你这个预算,对于做AI推理来说,其实很“富裕”了!千万别被那些动不动就上百万的“训练”服务器吓到。听我一句劝,你的思路要转个弯。

对于制造业的AI质检(比如AOI光学检测),这属于“模型推理”场景,不需要从零开始训练一个AI大模型,而是把别人训练好的成熟模型拿来用。所以,你根本不需要去买那种8卡GPU的“核弹头”。

2026年的市场,有一种东西叫“CPU AI加速型服务器”。简单说,就是利用最新的英特尔至强6处理器(那种带AMX加速引擎的),它里面自带AI算力,不用额外插昂贵的GPU卡,就能把图像识别跑得飞快 -8。这种机器,单台价格可能就十几万到几十万,剩下的钱,你完全可以投入到“散热改造”和“高速网络”上。或者,你也可以看看像高通、英特尔推出的那种专门做推理的芯片方案,功耗低,价格也友好 -9。记住,把钱花在刀刃上,别买屠龙刀去杀鸡,浪费!你还可以考虑租用一些算力服务商的资源先跑跑看,验证一下效果,再决定是否买断硬件 -9。

网友“北漂的IT仔”问:

老板让我全权负责采购一批AI服务器,但我发现市面上代理商太多了,从品牌厂商的代理到那种啥牌子都卖的小渠道,我该怎么选才不会背锅?

答

兄弟,你这个情况我太懂了!这就叫“责任重大,风险极高”。我给你支个招,选代理的时候,别光看价格,你得看“资质”和“案例”。

第一,要看“厂家授权”。像那种啥牌子都能倒腾的,虽然价格可能低,但后期一旦出问题,厂家不认,他们又没能力修,你就等着背锅吧。尽量找那种是“官方认证钻石代理商”或“金牌代理”的,比如有的代理商是超聚变的钻石代理,这种在货源和售后上都有保障 -2。第二,要看“实施案例”。你得问他,在你们这个行业(比如金融、医疗或者互联网),有没有给同类型客户交付过?能不能去现场看看?别听他吹牛,看了实物才放心。特别是看看他们之前做的机房布线、散热管理是不是规整,细节见真章。第三,要看他能不能提供“一站式”。这包括前期的方案设计、中期的上架部署、后期的运维对接。最好是那种“源头直供”的,价格有优势,服务还省心 -2。如果这个代理商能把你从选型到压力测试的全流程都包了,甚至能帮你搞定验收时那“连续7天压力测试不宕机”的苛刻要求 -3,那这锅,你想背都背不上。

网友“技术宅老张”问:

我刚入行做IT采购,听说现在的AI服务器都在搞“液冷”和“国产化”,这两个趋势对我们采购决策有啥影响?是不是必须得选液冷的?国产的芯片靠谱吗?

答

老张,你这个问题问到点子上了,说明你做了功课!这两个趋势,恰恰是2026年AI服务器选型避不开的坎儿。

先说“液冷”。是不是必须选?我的答案是:看你打算用多久,以及用的多狠。如果你只是买一两台跑跑开发测试,风冷勉强能顶住。但如果你是做7x24小时的高负载推理或模型微调,那液冷几乎是“必选项”。因为现在的GPU功耗太变态了,有的已经飙到2300W一张 -9,风冷根本压不住。一旦降频,你损失的性能成本远高于买液冷那点差价。而且液冷还能帮你把PUE降到1.15以下,电费能省下一大笔 -2,长远看更划算。

再说“国产化”。这也是个大趋势。现在供应链不稳定,加上政策推动,国产替代已经是个确定性方向了。你说靠谱吗?得分开看。对于“推理”场景,现在的国产GPU(比如沐曦等)已经相当能打了,性能对标国际主流,而且有国内厂商的深度适配 -6-7。但对于“训练”大模型,如果你想跑Llama 3这种顶尖的开源模型,目前英伟达的生态(CUDA)还是最成熟的。不过华为昇腾的集群方案也在快速追赶,配合“灵衢”互联协议,已经能做到大规模部署 -9。所以,我的建议是:别搞“二极管”。 如果你们是金融、政府等对安全要求极高的行业,优先考虑“全栈国产化”方案,哪怕性能差一点,但胜在自主可控。如果是对性能和生态要求极致的互联网公司,就按需混搭。一个好的代理商,应该是能同时提供国产和英伟达方案,并且帮你权衡利弊的人 -9。