北京时间2026年4月10日

在人工智能与移动终端深度融合的今天,手语识别与翻译已成为衡量智能设备“数字包容”能力的关键技术指标。华为AI手语助手通过端侧AI推理、分布式协同架构和多模态动作生成三大核心技术,构建了一套完整的手语无障碍沟通方案。本文将从技术痛点出发,逐步拆解手势识别(Hand Gesture Recognition)与手语转写(Sign Language Transcription)两个核心概念,给出可运行的代码示例,剖析底层原理,并提炼高频面试考点,帮助技术学习者建立从“会用”到“懂原理”的完整知识链路。

一、痛点切入:为什么需要AI手语助手?

先看一个典型的“云端AI”手语识别流程:

听障用户做手语动作 → 摄像头拍摄 → 上传视频到云端 → 云端模型识别 → 网络回传结果 → 显示文字/播报语音这套流程存在三个致命缺陷:

延迟灾难性:一次完整的“上传-识别-回传”耗时通常在1秒以上,对话场景根本无法接受。

网络依赖严重:在地下室、偏远地区等信号不佳的场景,App直接“瘫痪”。

隐私泄露风险:涉及银行卡密码、健康状况等敏感信息的对话视频流传至云端,安全隐患巨大-2。

华为AI手语助手的解决思路很清晰:端侧AI解决实时与隐私问题,分布式技术解决全场景协同问题,实现“0延迟、0网络依赖、0隐私泄露”的目标-2。

二、核心概念讲解:手势识别(Hand Gesture Recognition)

定义:手势识别(Hand Gesture Recognition, HGR)是指通过计算机视觉技术,从图像或视频流中检测手部位置、识别手部关键点,并判断手势类型的技术过程。

拆解关键词:

检测(Detection) :从画面中找到手的位置和区域。

关键点识别(Keypoint Detection) :定位手指、指节、手腕等21个关键点的坐标。

分类(Classification) :根据关键点坐标和手指方向,匹配手势类别(如👍、✌️、🤞等)。

生活化类比:手势识别就像“人脸识别”但更精细——人脸只需要找眼睛鼻子嘴的位置,而手语识别需要同时追踪每根手指的角度和弯曲程度,细微差异就可能改变整个词义-28。

核心价值:手势识别是手语翻译的“信号采集层”,没有精准的手势捕捉,后续的语义转写就无从谈起。

三、关联概念讲解:手语转写与生成(Sign Language Transcription & Generation)

定义:手语转写是指将识别到的手语动作序列翻译为自然语言文本/语音的过程;手语生成则是其逆向过程——将文本/语音转换为连贯的手语动作数据。

华为HMS Core手语服务将这一过程拆解为两大模块:

基于机器翻译的手语转写模块:通过自研中文预训练语言模型,提升手语转写的精度和速度-1。

基于多模态融合的手语动作表情生成模块:生成自然连贯的手语动作,在高质量动捕数据较少的情况下,仍能保证动作的准确性和平滑性-1。

与手势识别的关系:

手势识别:解决“是什么动作”(what)

手语转写:解决“是什么意思”(meaning)

手势识别是“输入采集”,手语转写是“语义解码”。两者配合才能完成完整的“手语→文字”翻译链条。

四、概念关系与区别总结

| 维度 | 手势识别 | 手语转写/生成 |

|---|---|---|

| 层级 | 底层感知层 | 上层语义层 |

| 输入 | 图像/视频帧 | 手势标签序列 |

| 输出 | 手势标签(如“比心”“OK”) | 自然语言文本或3D动作数据 |

| 技术核心 | 计算机视觉 + 关键点检测 | NLP + 序列建模 + 动作生成 |

一句话记忆:手势识别是“看懂手在比什么”,手语转写是“理解比划的意思”——前者解决感知问题,后者解决语义问题。

五、代码示例:手部关键点识别实战

华为ML Kit提供手部关键点识别服务,可识别手部21个关键点(包括指尖、指节、手腕),并返回各关键点坐标-3。

5.1 依赖配置

// 项目级 build.gradle 配置华为Maven仓库 allprojects { repositories { maven { url 'https://developer.huawei.com/repo/' } } } // 模块级 build.gradle 添加依赖 dependencies { // 基础SDK implementation 'com.huawei.hms:ml-computer-vision-handkeypoint:2.0.2.300' // 关键点检测模型 implementation 'com.huawei.hms:ml-computer-vision-handkeypoint-model:2.0.2.300' }

5.2 核心代码实现

// 1. 创建手部关键点分析器 val settings = MLHandKeypointAnalyzerSetting.Factory() .setSceneType(MLHandKeypointAnalyzerSetting.TYPE_ALL) // 返回全部结果 .setMaxHandResults(2) // 最多检测2只手 .create() val analyzer = MLHandKeypointAnalyzerFactory.getInstance() .getHandKeypointAnalyzer(settings) // 2. 设置结果回调 analyzer.setTransactor(object : MLAnalyzer.MLTransactor<MLHandKeypoints> { override fun transact(result: MLAnalyzer.Result<MLHandKeypoints>) { // 处理识别结果 for (hand in result.analyseList) { // 遍历21个关键点坐标 for (point in hand.handKeypoints) { Log.d(TAG, "关键点坐标: (${point.pointX}, ${point.pointY})") } } } }) // 3. 创建MLFrame并执行检测 val frame = MLFrame.fromBitmap(bitmap) analyzer.asyncAnalyseFrame(frame)

5.3 执行流程说明

初始化分析器,配置场景类型和最大手部数量。

将摄像头采集的Bitmap封装为MLFrame对象。

调用

asyncAnalyseFrame()异步执行关键点检测。检测完成后,

transact()回调返回21个关键点的精确坐标。开发者可基于坐标数据进行手势分类或传递给手语翻译模块-3。

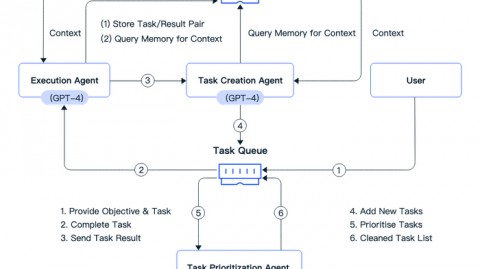

六、分布式协同:跨设备无缝沟通的技术突破

传统Android手语识别方案面临一个难题:即便手机端实现了识别,如何让手表显示文本、让音箱播报语音?跨设备生态割裂导致“全场景”体验无从谈起-2。

鸿蒙分布式软总线技术给出了解决方案。以“灵犀”手语翻译助手为例,通过分布式能力将手机(AI视觉+翻译)、手表(提醒+文本)、智慧音箱(语音播报)组合成“超级服务终端”,为听障人士打造“眼、耳、口”一体化的沟通体验-2。

核心技术实现:

设备发现:基于

ServiceDiscoveryManager,300ms内完成周边设备探测。数据分片:通过

DistributedDataManager将视频流切割为128KB数据块。优先级调度:利用

AbilityStage的onMemoryLevel回调动态调整同步策略。

在2025年残联组织的实地测试中,这套架构支持10台设备同时在线协作,数据同步延迟稳定在50ms以内-6。

七、底层原理与技术支撑

华为AI手语助手的底层依赖三大技术支柱:

7.1 计算机视觉 + 关键点检测

基于深度神经网络(DNN)的手部姿态估计模型,从单张RGB图像中定位21个关键点的2D/3D坐标。

关键技术包括热力图回归(Heatmap Regression)、图卷积网络(GCN)捕捉手指关节拓扑关系。

7.2 NLP预训练语言模型

华为自研中文预训练语言模型,支撑“手势标签序列 → 自然语言文本”的语义转换。

采用整体替代机制和模型加速技术,提升手语转写的精度和速度-1。

7.3 多模态动作融合生成

基于多模态融合技术,生成连贯的3D手语动作数据,不仅包含手部动作和身体姿态,还支持10种面部表情的生成-1。

7.4 端侧AI + NPU加速

模型轻量化 + NPU(神经网络处理单元)调度,实现手势识别模型在手机端的实时推理,平均功耗控制在12mA以内,识别延迟从200ms降至80ms-6。

八、高频面试题与参考答案

Q1:手语识别和普通手势识别有什么区别?技术难点在哪里?

参考答案:手语识别的核心难点在于“细微性”和“多模态”:

细微性:部分手语词汇的差异仅体现在手指的微小动作(如弯曲程度、伸展角度),对关键点检测精度要求极高。

多模态:手语表达依赖手部动作、肢体姿态、面部表情三者的协同,不能仅靠手部关键点-28。

连贯性:手语是连续动作序列,而非孤立手势,需要时序建模能力。

Q2:华为HMS Core手语服务的技术架构是怎样的?

参考答案:分为两大模块:

手语转写模块:基于自研中文预训练语言模型,将手势序列翻译为自然语言。

手语动作生成模块:基于多模态融合技术,将文本生成连贯的3D手语动作(含手部、身体、10种面部表情)-1。

Q3:为什么手语识别要采用端侧AI而不是云端AI?

参考答案:三个核心原因:

实时性:对话场景需要毫秒级响应,云端“上传-识别-回传”延迟不可接受。

隐私保护:对话内容可能涉及敏感信息,端侧处理避免数据外传。

网络依赖:端侧模型在无网络环境下仍可正常工作-2。

Q4:鸿蒙分布式技术在手语助手中解决了什么问题?

参考答案:解决了“全场景协同”问题。利用分布式软总线,将手机(识别+翻译)、手表(文本提醒)、音箱(语音播报)等设备整合为统一服务终端,实现跨设备无感协作,解决传统方案中设备生态割裂的痛点-2。

Q5:手部关键点识别能检测多少个点?支持哪些应用场景?

参考答案:可检测手部21个关键点(包括指尖、指节、手腕),支持静态图像和实时摄像头流两种模式。应用场景包括:手语字母识别、2D角色动画同步、手势特效生成、无接触设备控制等-11。

九、结尾总结

回顾全文,我们梳理了华为AI手语助手的技术全貌:

痛点认知:传统云端手语识别存在延迟、隐私、网络依赖三大问题。

核心概念:手势识别(HGR)负责“捕捉动作”,手语转写与生成负责“理解语义”——两者缺一不可。

代码实践:通过华为ML Kit的21个手部关键点检测API,可快速搭建手势识别基础能力。

架构亮点:端侧AI保障实时与隐私,分布式软总线实现全场景协同。

底层支撑:计算机视觉、NLP预训练模型、多模态融合、NPU加速四层技术栈。

易错点提醒:很多初学者容易混淆“手势识别”和“手语翻译”的概念——前者输出手势标签,后者输出自然语言文本,两者是感知层与语义层的关系,不能混为一谈。

下一篇我们将深入探讨端侧AI模型的轻量化技术——如何在手机NPU上部署手语识别模型,包括模型剪枝、量化、算子适配等实战经验,敬请期待。