2026年4月9日,北京

在AI大模型从“能用”迈向“好用”的深水区,华为盘古大模型以“模型能力+开发平台”的双核架构走出了一条独特的技术路线。许多开发者和学习者对盘古的认知仍停留在“又一个国产大模型”的表面,缺乏对技术原理、开发实践和面试考点的系统理解。

本文将带读者从概念到原理、从代码到面试,构建对盘古AI助手的完整知识链路,涵盖其技术架构、五大基础模型能力、核心创新技术(Triplet Transformer与快慢思考融合),并提供可运行的API调用示例与高频面试题,帮助技术学习者和开发工程师真正掌握这一重要技术体系。

一、痛点切入:为什么需要盘古大模型服务

先看一个典型的企业AI落地场景:某制造企业想用AI做产品缺陷检测。传统做法是:收集数千张缺陷样本,训练一个专用的CV小模型。但换一个产品线、换一个拍摄角度,模型准确率就大幅下降,需要重新训练。

这种“一事一训”的模式,暴露了传统AI开发的三重痛点:泛化能力差——换个场景就失效;开发门槛高——需要大量标注数据和专业算法工程师;维护成本高——每个场景都要单独训练、部署、更新。

盘古大模型正是为解决这些问题而生。它以“大模型预训练 + 行业微调”的范式,将通用能力预置在千亿参数的基础模型中,企业只需用少量行业数据进行微调,即可获得高精度的垂直场景AI能力。

传统方案 vs 盘古方案对比 传统方案流程: 数据收集 → 人工标注 → 模型训练 → 部署 → 场景变更 → 从头再来 周期:数周至数月 盘古方案流程: 盘古基础大模型 → 少量行业数据微调 → 一键部署 周期:数天

二、核心概念讲解:盘古大模型服务

标准定义

盘古大模型服务(Pangu Large Model Service) 是华为云推出的面向行业的、全栈式人工智能产品组合。它不仅仅是单一的模型算法,也不仅仅是一个软件平台,而是以“模型能力 + 开发平台”为核心架构,整体由“盘古系列大模型”与“ModelArts Studio大模型开发平台”两大板块组成,形成从模型供给到全流程开发的完整服务闭环-1。

核心组成拆解

| 组成部分 | 角色定位 | 核心价值 |

|---|---|---|

| 盘古系列大模型 | 模型能力供给 | 用户真正调用的“模型本体” |

| ModelArts Studio | 开发与落地入口 | 数据管理、训练、部署全流程工具链 |

| 三方大模型 | 能力边界扩展 | 涵盖DeepSeek、Qwen等160+模型 |

生活化类比

可以把盘古大模型服务理解为“中央厨房+烹饪平台”:

盘古系列大模型是中央厨房提前备好的优质“预制菜”(基础能力)

ModelArts Studio是一套完整的“烹饪工具链”,从食材处理(数据处理)到烹饪(模型训练)到摆盘上桌(部署应用)

企业拿到后,可以按自己的口味微调(行业适配),快速出品专属AI应用

五大基础模型能力

盘古系列大模型提供NLP、多模态、CV、预测、科学计算五大核心基础能力模型-1:

盘古NLP模型:千亿参数加持,深耕中文语境,具备对话问答、文案生成、逻辑推理、知识抽取等能力-1

盘古CV大模型:基于海量图像预训练,具备极强泛化能力,极少量样本即可训练高精度缺陷检测模型-1

盘古预测大模型:专攻结构化数据与时序数据,捕捉非线性关联-1

盘古多模态大模型:打破视觉与语言的界限,支持以图搜图、图文摘要、视频理解-1

盘古科学计算大模型:气象领域可在几秒内完成全球未来10天天气预测,精度超传统数值预报方法,计算速度提升10000倍以上-1

三、关联概念讲解:ModelArts Studio开发平台

标准定义

ModelArts Studio大模型开发平台是盘古大模型服务推出的“一站式大模型工具链平台”,以“支持百模千态”为目标,构建了数据、模型的开发体系,为大模型的全生命周期开发提供工具支撑-2。

平台核心工具链

1. 数据工程工具链:围绕“数据全流程管理”设计,涵盖数据获取、数据清洗、数据合成、数据标注、数据评估、数据配比、数据发布与管理七大核心功能-2。

2. 模型开发工具链:提供从模型训练、压缩、部署、评测到推理的一站式解决方案,依托高效的推理性能优化技术与跨平台迁移工具,保障模型在不同硬件环境中的高效运行-2。

盘古模型与ModelArts Studio的关系

盘古大模型通过ModelArts Studio大模型开发平台承载。用户在平台上可以使用自己的数据训练和微调模型,对训练的模型进行压缩、评测、部署,也可以在平台上创建自己的Agent应用-2。

四、概念关系与区别总结

| 维度 | 盘古系列大模型 | ModelArts Studio |

|---|---|---|

| 角色 | 能力供给方(模型本体) | 能力承载方(开发平台) |

| 关系 | 被承载 | 承载方 |

| 价值 | 提供AI能力“原材料” | 提供从原材料到成品的一站式工具链 |

| 类比 | 预制菜 | 中央厨房+烹饪工具 |

一句话记忆:盘古系列大模型是“能力”,ModelArts Studio是“平台”;没有模型,平台只是空壳;没有平台,模型只是静态文件-1。

五、代码示例:使用API调用盘古NLP大模型

准备工作

完成华为云账号注册与实名认证

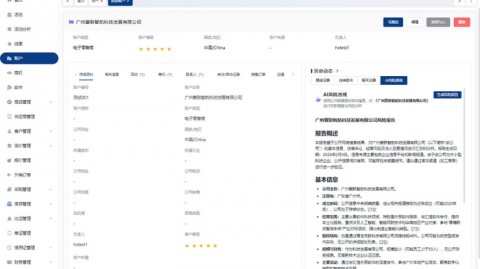

进入ModelArts Studio平台申请盘古大模型使用权限

获取API Key与Project ID-22

Python调用示例

import requests import json 配置参数 api_key = "your_api_key_here" endpoint = "https://api.pangu.cloud/v1/models/pangu-alpha:predict" 构建请求 headers = { "X-Api-Key": api_key, "Content-Type": "application/json" } data = { "messages": [ {"content": "介绍下盘古大模型的核心技术特点"} ], "temperature": 0.7, 控制随机性,0-1之间 "max_tokens": 500 最大生成长度 } 发送请求 response = requests.post(endpoint, headers=headers, json=data) 处理响应 if response.status_code == 200: result = response.json() print(result["choices"][0]["message"]["content"]) else: print(f"请求失败: {response.status_code}")

使用Postman调用(API Key认证)

请求Header:

X-Api-Key: your_api_key_value Content-Type: application/json

请求Body:

{ "messages": [ {"content": "介绍下长江,以及长江中典型的鱼类"} ], "temperature": 0.9, "max_tokens": 600 }

调用路径:/v1/{project_id}/deployments/{deployment_id}/chat/completions-24

调用注意事项

QPS限制:默认每秒10次,需通过异步队列或批处理优化-22

输入长度:NLP模型单次输入不超过2048个token-22

认证方式:支持Token认证和API Key认证-24

六、底层原理与技术支撑

6.1 核心架构:Triplet Transformer

盘古预测大模型采用业界首创的Triplet Transformer统一预训练架构。该架构将不同行业的数据——包括工艺参数的表格数据、设备运行日志的时间序列数据、产品检测的图片数据——进行统一的三元组编码,在同一框架内高效处理和预训练,极大地提升了预测精度和跨行业、跨场景的泛化性-。

💡 理解关键:传统模型针对不同类型数据(表格、时序、图片)需要不同的处理架构,而Triplet Transformer将它们统一为“三元组”表示,实现了一个模型处理多源异构数据。

6.2 快慢思考融合机制

盘古NLP大模型引入了基于人脑启发的新机制:自适应快慢思考合一。

人脑有两种思考模式:系统一是快思考(日常对话、简单判断),系统二是慢思考(数学推理、复杂问题分析)。盘古模型将这两种能力融合到同一个模型中,无需用户手动选择模式,模型会根据输入问题的复杂度自动切换,实现更灵活、高效的推理-52。

6.3 底层技术栈

| 层级 | 技术组件 | 作用 |

|---|---|---|

| 芯片层 | 昇腾910B(320TOPS算力) | 算力底座,支持FP16与INT8混合精度计算-22 |

| 框架层 | MindSpore | 自动并行与图编译优化,训练效率较PyTorch提升30%-22 |

| 平台层 | ModelArts Studio | 可视化训练界面与自动化调参工具-22 |

| 架构层 | 盘古-π Transformer | 解决特征塌陷问题,同规模性能超LLaMA- |

6.4 “5+N+X”三层训练架构

盘古大模型采用“5+N+X”三层架构,将训练过程分解为三个阶段-54:

L0基础层:五大基础模型(NLP、CV、多模态、预测、科学计算)通过千亿级参数预训练形成通用能力底座

L1行业层:通过行业数据增强实现垂直领域适配

L2场景层:聚焦具体业务场景,采用微调与知识蒸馏技术

七、高频面试题与参考答案

面试题1:请介绍盘古大模型服务的整体架构。

参考答案要点:

整体架构为“模型能力 + 开发平台”双核结构

模型部分:盘古系列大模型(五大基础模型:NLP、CV、多模态、预测、科学计算)+ 三方大模型(DeepSeek、Qwen等)

平台部分:ModelArts Studio大模型开发平台,提供数据工程、模型开发、Agent开发等全流程工具链

核心价值:形成从模型供给到全流程开发的完整服务闭环-1

💡 加分点:点出两者“相辅相成、缺一不可”的协同关系——没有模型,平台是空壳;没有平台,模型是静态文件。

面试题2:盘古大模型在Transformer架构上做了哪些创新?

参考答案要点:

Triplet Transformer:首创统一预训练架构,将表格、时序、图片数据统一为三元组编码,提升跨场景泛化性-

盘古-π架构:解决原始Transformer的特征塌陷问题,增强非线性,同规模性能超LLaMA-

昇腾亲和优化:针对昇腾AI处理器深度优化推理效率

面试题3:盘古NLP大模型的“快慢思考融合”是什么?有什么优势?

参考答案要点:

概念:基于人脑启发,将系统一(快思考,日常对话)和系统二(慢思考,深度推理)融合到同一模型中

优势:无需用户手动选择模式,模型根据问题复杂度自动切换;无需训练两个独立模型,更高效-52

实现方式:通过难易感知的快慢思考数据融合 + 由慢到快的渐进式训练-52

面试题4:盘古大模型如何解决企业AI落地中的数据挑战?

参考答案要点:

数据合成技术:通过weak2strong方法,以弱模型辅助强模型迭代合成高质量数据,弥补高质量自然数据增长不足-14

课程学习策略:利用较小模型评估数据难度,让模型从易到难学习,实现可控能力涌现-14

数据工程工具链:提供数据获取、清洗、合成、标注、评估等七大核心功能-2

面试题5:盘古大模型的开发接入方式有哪些?

参考答案要点:

API调用:通过RESTful API接入,需获取API Key,支持Python/Java/PHP等多种语言

SDK接入:使用华为云SDK进行集成

Agent开发平台:通过ModelArts Studio创建Agent应用,支持画布式节点设计、插件扩展、RAG检索等-41

八、总结与进阶预告

核心知识点回顾

整体架构:盘古大模型服务 = 盘古系列大模型(能力供给) + ModelArts Studio(开发平台)

五大基础模型:NLP、CV、多模态、预测、科学计算,覆盖主流AI应用场景

核心技术:Triplet Transformer统一预训练架构 + 快慢思考融合机制 + 盘古-π架构

开发实践:通过API/Agent开发平台接入,支持多语言调用和全流程开发

底层支撑:昇腾芯片 + MindSpore框架 + ModelArts平台构成全栈AI基础设施

进阶学习方向

Agent开发:如何使用盘古大模型创建智能体应用

模型微调:在盘古基础模型上进行SFT(监督微调)的实战技巧

边缘部署:使用MindSpore Lite进行端侧模型转换与NPU加速

RAG应用:结合向量数据库构建企业知识库问答系统

下一篇将深入讲解如何使用盘古大模型开发企业级RAG应用,从向量数据库选型到检索增强生成的完整实现,敬请期待。